GLM-5.1 není nový model. Je to post-tréninkový upgrade GLM-5, vydaný 27. března 2026 — šest týdnů po původním GLM-5 a pouhých dvanáct dní po GLM-5-Turbo. Architektura zůstala beze změny: 744 miliard parametrů celkem, 40 miliard aktivních při inferenci (Mixture of Experts, 256 expertů, 8 aktivovaných na token), kontext 200 000 tokenů, DeepSeek Sparse Attention. Co Z.ai změnil: reinforcement learning pipeline zaměřil specificky na kódovací úlohy.

GLM-5.1 je tedy nástroj pro autonomní kódovací agenty na dlouhých úlohách, ne pro rychlé interaktivní odpovědi nebo vědecké uvažování. Je to jiný design intent než u Claudu nebo GPT-5.4, které jsou primárně obecné modely s kódovacími schopnostmi. GLM-5.1 to má obráceně — je to kódovací/agentní systém s obecnými schopnostmi jako doplňkem.

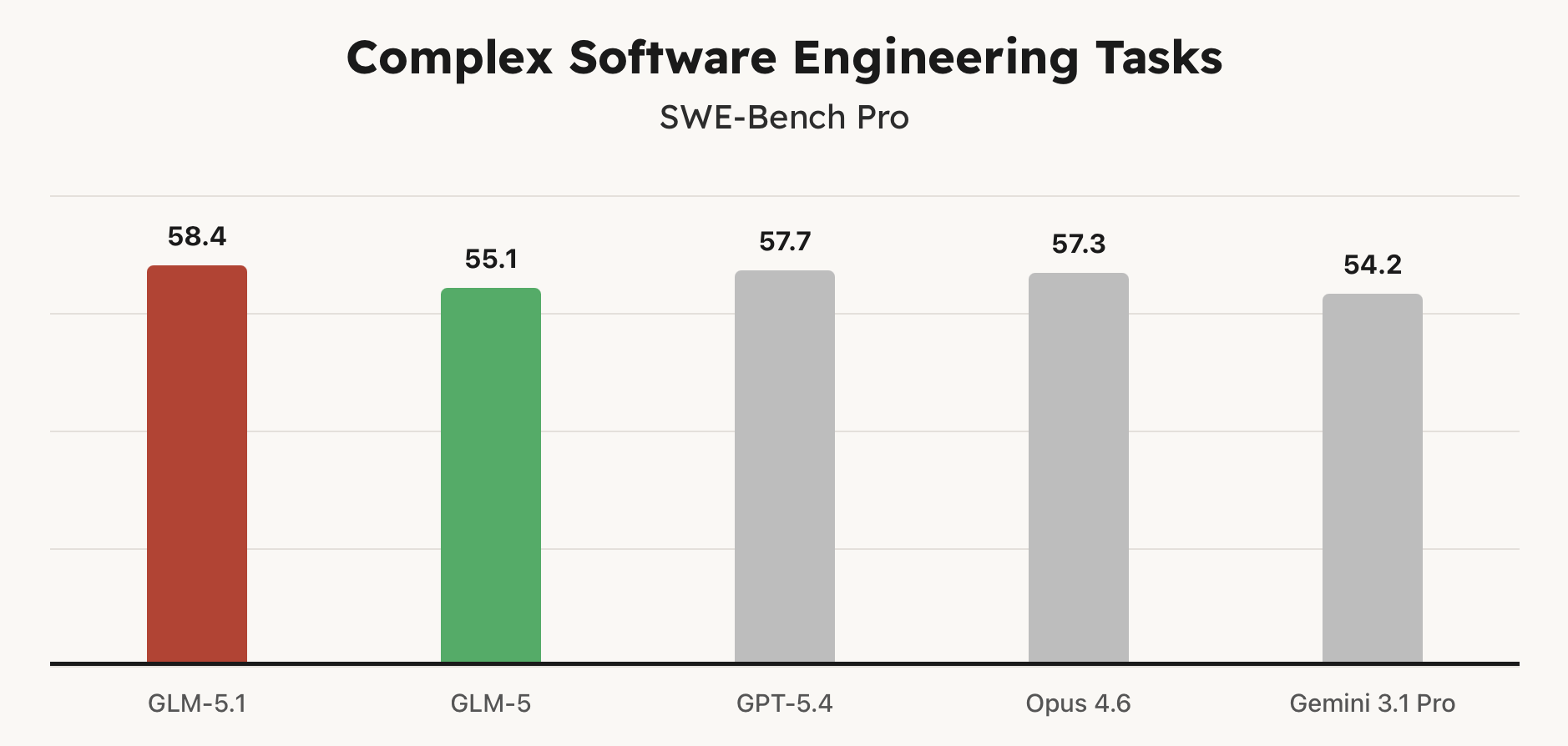

Výsledky tohoto zaměření Z.ai dokumentuje na třech testech:

Na SWE-Bench Pro (komplexní softwarové inženýrství) dosahuje GLM-5.1 58,4 % — oproti 55,1 % u GLM-5, 57,3 % u Claude Opus 4.6 a 57,7 % u GPT-5.4. Jde o nejvyšší reportované skóre na tomto benchmarku. Na NL2Repo (generování repozitáře z přirozeného jazyka) vede údajně GLM-5.1 s 42,7 % nad Opus 4.6 (36,7 %) i GPT-5.4 (41,3 %). Na Terminal-Bench 2.0 (Claude Code harnes) dosahuje 66,5 %, GPT-5.4 reportuje 75,1 % na vlastním Codex harnesu — přímé srovnání je metodologicky problematické, protože oba modely byly měřeny na jiných harnesech.

Dřívější mediálně rozšířené číslo „94,6 % výkonu Opus 4.6” pocházelo z jiného, proprietárního kódovacího harnesu Z.ai (45,3 vs. 47,9 bodu) a neodpovídá SWE-Bench Pro datům zveřejněným v oficiálním blogu.

Všechna tato čísla jsou sebehlášená Z.ai a ke dni vydání blogu nebyla nezávisle ověřena.

Harnes je obslužný kód kolem modelu — prostředník, který mu dává úkoly, spravuje prostředí, sbírá výsledky a rozhoduje, co se počítá jako úspěch. Nevíme tedy, kolik z rozdílu mezi měřenými modely tvoří skutečný rozdíl modelů a kolik tvoří rozdíl harnesů.

Jak je na tom GLM-5.1 v nezávislých měřeních?

Sebedeklarace je jedna věc, ale jaké jsou nezávislé testy? Jediná nezávisle ověřená čísla pro rodinu GLM-5 pocházejí z Artificial Analysis: základní GLM-5 dosáhl skóre 50 na Intelligence Indexu (lídři Gemini 3.1 Pro Preview a GPT-5.4 jsou na 57, Opus 4.6 na 53), Elo 1412 na GDPval-AA znalostních úlohách (oproti 1633 u Sonnet 4.6 a 1606 u Opus 4.6), a nejnižší míru halucinací v celém testovaném poli na AA-Omniscience indexu. Na SWE-Bench Verified bylo nezávisle potvrzeno 77,8 % pro GLM-5. Pro GLM-5.1 specificky žádná nezávislá čísla ke dni vydání blogu neexistují — vše ostatní v tomto článku jsou vlastní data Z.ai, která najdete na jejich blogpostu.

Zásadní výhrada: harnes a metodologie

Oficiální blog Z.ai pracuje s několika různými benchmarkovými harnesu, a jejich míchání vedlo ke zmatkům v mediálním pokrytí:

Číslo 45,3 vs. 47,9 (94,6 % výkonu Opus 4.6) pocházelo z proprietárního Z.ai kódovacího harnesu — nikoli z SWE-Bench Pro ani SWE-Bench Verified. Na SWE-Bench Pro, který Z.ai reportuje v oficiálním blogu, GLM-5.1 dosahuje 58,4 % a skutečně vede před Opus 4.6 (57,3 %) a GPT-5.4 (57,7 %). Tato čísla jsou ovšem sebehlášená a metodologicky odlišná od toho, jak Anthropic a OpenAI své výsledky reportovaly.

Terminal-Bench 2.0 je měřen dvěma různými harnesu: Z.ai reportuje GLM-5.1 na Claude Code harnesu (66,5 %), GPT-5.4 reportuje svůj výsledek na Codex harnesu (75,1 %). Přímé srovnání těchto čísel je pochybné.

Historicky GLM-5 sebehlášené benchmarky při nezávislém ověření obstály (SWE-Bench Verified 77,8 % bylo potvrzeno). Ale pro GLM-5.1 toto ověření ke dni vydání blogu chybí.

Struktura výhod a nevýhod

Kde GLM-5.1 reálně vede nebo je konkurenceschopný:

- SWE-Bench Pro: 58,4 % — nejvyšší reportované skóre, před Opus 4.6 (57,3 %) i GPT-5.4 (57,7 %) (sebehlášené, neověřeno)

- NL2Repo (generování repozitáře): 42,7 % — vede před Opus 4.6 (36,7 %) i GPT-5.4 (41,3 %) (sebehlášené)

- Halucinace: nejnižší míra v nezávislém testování (ověřeno pro GLM-5 na AA-Omniscience)

- Cena: API $1,00/$3,20 na milion tokenů vs. Opus 4.6 $5/$25 — přibližně 5–8× levněji; Coding Plan od $10/měsíc vs. Claude Max $100–200/měsíc

- Open-weight pod MIT licencí: váhy dostupné na HuggingFace a ModelScope, nasaditelné přes vLLM a SGLang

- Hardwarová nezávislost: trénován výhradně na 100 000 kusech Huawei Ascend 910B — bez jediného Nvidia GPU

Kde GLM-5.1 za americkými modely zaostává:

- Reasoning benchmarky: GPQA-Diamond 86,2 % vs. GPT-5.4 92,0 % a Opus 4.6 91,3 %; HLE 31,0 % vs. GPT-5.4 40,7 % a Opus 4.6 36,7 %

- KernelBench Level 3: 3,6× speedup vs. Opus 4.6 4,2× — a Opus 4.6 „ještě ukazoval prostor pro zlepšení” (přiznává Z.ai)

- Rychlost: 44,3 tokenů za sekundu — nejpomalejší model ve své třídě, přibližně na polovině rychlosti GPT-5.4

- Kontext: 200 000 tokenů oproti 1M u Gemini 3.1 Pro Preview a GPT-5.4 (API)

- Multimodalita: pouze text — žádné nativní video, audio ani generování obrázků

- Computer use: schopnost autonomního ovládání počítače chybí; GPT-5.4 i Opus 4.6 ji mají nativně

- Geografie: Z.ai je na US Entity Listu od ledna 2025 — compliance bariéra pro část enterprise nasazení bez ohledu na výkon

- Nezávislé ověření GLM-5.1 čísel: ke dni vydání blogu chybí

- Nestabilita při zátěži: po vydání GLM-5 vzrostl provoz 10×, služba byla několik dní nestabilní

Klíčový diferenciátor: dlouhý horizont

Z.ai staví GLM-5.1 na jiné myšlence než konkurence: model nemá být nejrychlejší nebo nejchytřejší na jedno kolo dotazů, ale nejefektivnější v dlouhé autonomní práci. Ostatní modely dostanou úkol, udělají co umí a skončí. GLM-5.1 je navržený tak, aby po prvním výsledku nepřestal — analyzoval, co nefunguje, změnil přístup a zkusil znovu. A znovu. Stokrát, šestsetkrát.

Z.ai to dokládá třemi scénáři. V prvním model optimalizoval databázi: tam kde Claude Opus 4.6 v běžné relaci dosáhl určitého výkonu, GLM-5.1 v autonomní smyčce přes šest set kol dosáhl výkonu šestinásobného — protože postupně sám přicházel na lepší strategie a přepínal mezi nimi. Ve druhém scénáři optimalizoval GPU kód: pokračoval v nacházení zlepšení déle než předchozí modely, i když Claude Opus 4.6 nakonec dosáhl lepšího celkového výsledku. Ve třetím postavil za osm hodin plnohodnotné desktopové prostředí v prohlížeči — soustavným přezkoumáváním vlastní práce a doplňováním toho, co chybělo.

Tyhle scénáře ale nelze brát jako standardní benchmark. Jsou to demonstrace navržené Z.ai, jednou spuštěné, bez nezávislého ověření. Ukazují směr, ne změřenou schopnost. Klíčová otázka — jestli se tenhle přístup osvědčí v reálných produkčních podmínkách — zatím zůstává bez odpovědi. A kromě toho - tento přístup bude stát hodně tokenů navíc, což blogpost Z.ai nezodpovídá. Jediné nákladové číslo v materiálech Z.ai je celková cena benchmark evaluace: GLM-5.1 stál $5 634 na celé sadě testů, Opus 4.6 $8 018, Gemini 3.1 Pro $911. Ale to jsou náklady na standardní benchmarky, ne na long-horizon scénáře.

Distilace: otevřená otázka

Při testování Pony Alpha (stealth pre-release GLM-5 na OpenRouter) model při zadání příkazu k vytvoření webové stránky popisující sebe konzistentně generoval text: „Jsem Claude, vytvořený společností Anthropic.” Tohoto chování bylo možno dosáhnout v 100 % případů. MIT výzkumníci v prosinci 2025 zdokumentovali, že GLM-series modely se identifikovaly jako Claude přibližně v 50 % případů při použití nestandardních metod. Zhipu nikdy neposkytl vysvětlení. Distilace — trénování modelu na výstupech jiného modelu — je v čínském AI průmyslu rozšířenou praxí. OpenAI obvinil DeepSeek ze distilace a aktualizoval podmínky použití; Anthropic, Mistral a xAI následovaly.

Tato otázka nemá definitivní veřejnou odpověď. Zmiňuji ji proto, že je pro čtenáře relevantní při rozhodování o nasazení.

Strategický kontext: tempo vydávání

GLM-5: 11. února 2026. GLM-5-Turbo: 15. března. GLM-5.1: 27. března. Tři vydání za šest týdnů. Z.ai dokončilo hongkonské IPO 8. ledna 2026 a získalo přibližně 558 milionů dolarů. Tento kapitál je viditelně přeléván do iterační rychlosti.

Celkový obraz čínského AI pole je přitom složitý: Alibaba ztratila v roce 2026 tři senior vedoucí z divize Qwen, CEO Eddie Wu převzal přímé řízení nové AI business group za otázek nad ziskovostí open modelů. DeepSeek stále vede v architektonickém přístupu, přičemž GLM-5 přijal DeepSeek Sparse Attention, což je silný signál o tom, kde technická průkopnost v čínském AI skutečně leží.

Co přichází: kontext pro duben 2026

GLM-5.1 vychází v momentě, kdy se AI kolbiště pole připravuje na další kolo. Relevantní ověřené signály:

Anthropic (6. dubna 2026): Run-rate revenue překročila 30 miliard dolarů — trojnásobek oproti 9 miliardám na konci roku 2025. Počet enterprise zákazníků utrácejících přes 1 milion dolarů ročně přesáhl 1 000, zdvojnásoben za méně než dva měsíce. Anthropic zároveň podepsal dohodu s Google a Broadcom na přibližně 3,5 gigawattu výpočetního výkonu postaveného na next-gen Google TPU kapacitě od roku 2027 — největší infrastrukturní závazek v historii firmy. Tato čísla hovoří o tom, že příští velký Claude model (spekuluje se o kódovém označení „Mythos”, žádné oficiální oznámení neexistuje) bude trénován na výrazně větším výpočetním výkonu než Opus 4.6. Zároveň se ale Antrhopic potýká s nedostatkem výkonu, výpadky služby a s rychlým vyplýtváním tokenů v Claude Code.

Meta — Llama 4: Llama 4 Maverick a Scout byly oznámeny s multimodálními schopnostmi a velmi velkým kontextovým oknem. Plné open-source vydání se očekává v průběhu dubna 2026. Pokud Llama 4 dodrží slibované parametry, otevře nové srovnání pro GLM-5.1 v open-source kategorii — Llama přichází s Metou za zády a bez geopolitických komplikací US Entity Listu.

OpenAI: GPT-5.5 se v komunitě zmiňuje jako očekávané vydání, žádné oficiální oznámení neexistuje.

Google Gemma 4, vydaná 2. dubna 2026 pod licencí Apache 2.0, je přímý konkurent GLM-5.1 ve většině prakticky relevantních dimenzí. Obě jsou open-source s komerční licencí, obě cílí na agentní workflow, obě běží na vlastním hardwaru. Na Arena AI žebříčku sedí Gemma 4 31B na Elo 1452, GLM-5 na 1451 — prakticky identické hodnocení od skutečných uživatelů v přímých soubojích. Gemma 4 přitom nabízí věci, které GLM-5.1 nemá: multimodalitu, podporu 140 jazyků, kontext 256K v cloudu, a především čistou komerční licenci bez geopolitického rizika — Z.ai je na US Entity Listu od ledna 2025, což pro část enterprise nasazení mimo Čínu vytváří compliance bariéru bez ohledu na výkon. Jedinou prokázanou oblastí, kde GLM-5.1 Gemmu 4 předčí, je long-horizon autonomní kódování — ale tato čísla jsou zatím sebehlášená a Gemma 4 žádnou analogickou demonstraci nepublikovala, takže srovnání nelze udělat. Pro většinu vývojářů zvažujících open-source alternativu k proprietárním modelům je Gemma 4 v tuto chvíli bezpečnější volba než GLM-5.1 — ne proto, že by byla prokazatelně lepší, ale proto, že má méně nevyřešených otázek.

Ještě tvrdší test pro GLM-5.1 přijde s Llama 4. Pokud Meta nabídne srovnatelný výkon bez compliance rizika Z.ai a bez omezení kontextového okna, argument pro GLM-5.1 v enterprise nasazení mimo Čínu se výrazně ztenčí. Open-source pole je v dubnu 2026 poprvé skutečně přeplněné konkurencí — a to je pro Z.ai problém, který benchmarky nevyřeší.

Bude to napínavé jaro s AI ♥️