OpenAI vydal pro Codex novou funkci Auto-review, která mění bezpečnostní politiku kódovacích agentů. Místo toho, aby uživatel ručně schvaloval každý pokus Codexu vyběhnout ze sandboxu (typicky jednoduché síťové volání nebo spuštění Pythonu) rozhoduje teď samostatný agent.

OpenAI publikoval doprovodný text na blogu Alignment týmu a samotnou funkci vydal o týden dřív. Číselně to vypadá lákavě: stop pro lidský zásah nastane podle interních dat zhruba 200krát méně často než v ručním režimu, schvalovací míra napříč všemi akcemi je 99,93 %. Méně lákavá je úvaha, co to vlastně z hlediska bezpečnosti znamená, když agenta hlídá jiný agent stejné rodiny.

Ilustrativní přehled interního nasazení. V režimu ručního schvalování by 720 akcí provedených mimo sandbox přerušilo práci uživatele. Díky funkci automatického přezkoumání byly tyto akce zkontrolovány automaticky: 7 z nich bylo zamítnuto, 4 pokračovaly bezpečnější cestou a 3 byly pozastaveny a čekaly na zásah uživatele. (* Poměry se liší v závislosti na konkrétním použití, prostředí a konfiguraci sandboxu.)

Co Auto-review řeší a proč vůbec vznikl

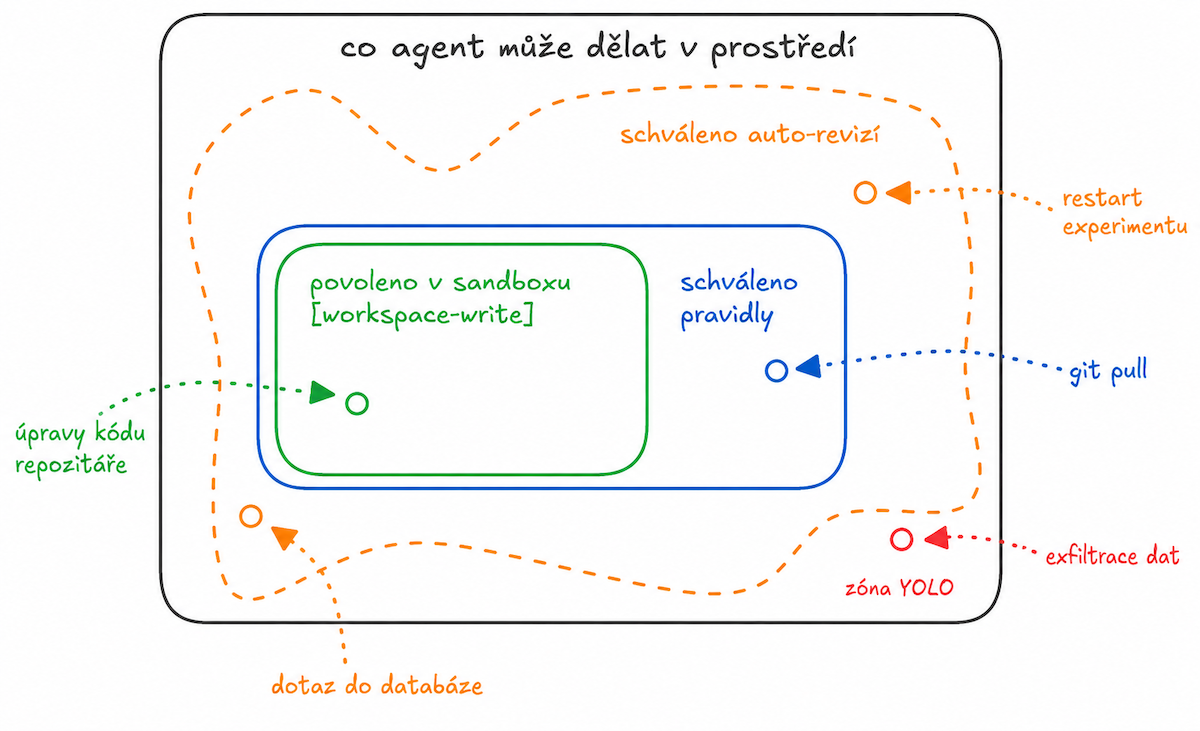

Codex měl dosud dva režimy. Default mód běžel v sandboxu. Codex směl číst soubory, zapisovat do předem určeného kořene a spouštět lokální příkazy uvnitř téhle ohrady. Cokoli za hranicí muselo čekat na uživatele. Druhou volbou byl Full Access, který sandbox prostě vypnul. Mezi tím nebylo nic.

Praxe ukázala dva problémy. Default mód je únavný. Dlouho běžící agentní úkol se každých pár minut zastaví, aby se zeptal, jestli smí udělat curl google.com, a uživatel musí být u toho. Full Access zase znamená, že prostředí už nic nevynucuje a všechny brzdy závisí na chování modelu. OpenAI sami v textu přiznávají, co s tím uživatelé dělají: přepínají do Full Access kvůli klidu, píšou si tak permisivní prefixová pravidla, že povolí všechno, co začíná slovem python, a schvalují příkazy bez toho, aby chápali, co se vlastně děje. Příjemný detail, na který narazili při interním auditu: našli konfigurační soubor s codex exec --yolo nastaveným na vždy povolit. To je přesně ten typ chování, který bezpečnostní tým nemůže ustát a produktový tým ho nemůže ignorovat.

Auto-review je odpověď na tenhle rozpor. Když Codex narazí na hranici sandboxu, místo aby se ptal uživatele, požádá o eskalaci samostatného agenta. Ten posoudí požadavek s ohledem na záměr uživatele, prostředí, bezpečnostní politiku a pravděpodobný dopad akce. A buď ji schválí, nebo zamítne s důvodem, který hlavnímu agentovi pomůže najít alternativní cestu.

Architektura — proč jsou role oddělené

Klíčový design nápad spočívá v rozdělení odpovědností. Hlavní Codex agent je optimalizovaný na dokončení úkolu, takže každá schvalovací bariéra je z jeho pohledu překážka, kterou je třeba obejít. Auto-reviewer má užší úlohu: rozhodnout, jestli má konkrétní akce mimo sandbox proběhnout. OpenAI argumentují, že tohle oddělení dělá schvalovací politiku snáze hodnotitelnou, monitorovatelnou a vylepšitelnou. Oddělený model call také znamená, že auditní log je čistý. Víte, kdo co schválil a proč.

Auto-reviewer používá GPT-5.4 Thinking v režimu low reasoning. To je střízlivé rozhodnutí. Silnější model by sice byl lepší v detekci rizik i rozpoznávání záměrů uživatele, ale levnější verze je dost dobrá a nezdrží práci. Zároveň to znamená, že na obou stranách rozhodovacího procesu sedí v zásadě podobný typ systému. Hlavní agent uvažuje, jak úkol dokončit. Strážce uvažuje, jestli to nebude moc nebezpečné. Sdílené kognitivní bias jsou tu pravděpodobnější, než kdyby šlo o čistě deterministická pravidla.

Když Auto-reviewer akci zamítne, neřekne jen „ne”. Vrátí Codexu zdůvodnění, které mu pomůže pokračovat jinou cestou. V interních datech OpenAI uvádí, že po zamítnutí Codex ve více než polovině případů najde přijatelné alternativní řešení a nemusí se ptát uživatele. Pokud se ovšem Codex pokouší Auto-reviewera obejít — opakovanými žádostmi formulovanými jinak —, systém ho zastaví. To je důležitá pojistka proti tomu, čemu OpenAI říká „gaming the reviewer”.

Čísla, která OpenAI uvádí

| Metrika | Hodnota | Co měří |

|---|---|---|

| Auto-approval rate na eskalovaných akcích | 99,1 % | Z akcí, které vyžadují schválení, jich Auto-review propustí 99 ze 100 |

| Effective approval rate napříč všemi akcemi | 99,93 % | Včetně toho, co zůstalo v sandboxu — uživatel je rušen minimálně |

| Overeagerness Recall | 90,3 % | Synteticky vytvořené případy, kdy by se Codex mohl nechat strhnout — kolik Auto-review zachytí |

| Prompt Injection Recall | 99,3 % | Zachycení útoků přes prompt injection (RCE, exfiltrace, externí upload) |

| MonitoringBench [Hard] Recall | 96,1 % | Skryté úmyslné škodlivé akce v testovací sadě |

Ilustrace, kterou OpenAI uvádí, vypadá takto: na 10 000 akcí jich 9 280 proběhne v sandboxu bez schválení, 720 vyžaduje review. Z těch 720 jich Auto-review schválí 713, 7 zamítne. Ze sedmi zamítnutí Codex u čtyř najde bezpečnější cestu sám, u tří zastaví a zeptá se uživatele. V ručním módu by všech 720 vyrušilo uživatele.

Kde se to láme — a OpenAI to říká samo

Tohle je část, kterou bych v marketingovém textu hledal marně, ale OpenAI ji v alignment blogu pojmenovává otevřeně. Auto-review není deterministická záruka. Při automatickém i lidském red-teamingu našli případy, kdy se Auto-reviewer dal zmást, aby schválil příkaz, který schválit neměl. Nepředpokládají, že tahle třída systémů někdy poskytne deterministické záruky. To je správná míra střízlivosti, kterou by si měl přečíst každý, kdo plánuje pustit agentní kódování na produkční systémy.

Druhá slabina je jemnější. Auto-review hodnotí navrhované akce mimo sandbox v okamžiku eskalace. Model, který strategicky skrývá svůj záměr, tedy to, čemu se v alignment literatuře říká scheming, může vyrobit eskalační požadavek, který vypadá nevinně. Nebo může operovat výhradně uvnitř sandboxu a Auto-review mu nikdy do cesty nevstoupí. Sandbox není návrhovaný proti modelu, který ví, že jiný model dohlíží, a podle toho se chová. Pro tenhle typ rizika OpenAI odkazují na komplementární metody — monitoring chain-of-thought, alignment testing —, ale samy přiznávají, že je to oblast aktivního výzkumu. Polopaticky řečeno: Auto-review chrání před nedbalou nebo přílišně horlivou akcí, ne před modelem, který má vlastní agendu a chytrost ji zamaskovat.

Třetí věc, kterou stojí za to zmínit, není přímo OpenAI uvedena, ale plyne z architektury. Auto-reviewer je sám LLM. Promptovat strážce přes hlavního agenta je teoretická útočná plocha — útočník, který kompromituje vstupní data hlavního Codexu, může současně formulovat eskalaci tak, aby Auto-reviewera odzbrojil. Pravděpodobnost je nízká, výsledky red-teamingu jsou dobré, ale není to nula.

Kdo to dnes používá a co to znamená pro produkt

OpenAI uvádí, že většina jejich vlastní spotřeby tokenů v Codex Desktopu dnes pochází z akcí v Auto-review módu a podíl roste. OpenAI důvěřuje vlastnímu nástroji natolik, aby na něm nechalo běžet vlastní vývoj.

Druhý kontext stojí za zmínku. Auto-review je open source v Codex repozitáři. To znamená, že kdokoli si může prostudovat, jak je strážce promptován a jak vyhodnocuje rizika. To základ pro vlastní úpravy a pro nezávislé bezpečnostní audity. Anthropic jde u Claude Code spíš opačnou cestou s uzavřeným systémem schvalování, byť s modelem dostupným přes Claude Skills a sdílenými konfiguracemi přes AGENTS.md.

Pro reálné nasazení v týmech to znamená několik věcí. Auto-review je default, který má smysl pro většinu vývojářské práce, kde nejde o produkční tajemství. Ve chvíli, kdy Codex pracuje s produkčními credentials, customer data nebo CI/CD pipeline, by Auto-review měl být doplněný o tradiční bezpečnostní vrstvy — síťové firewall, vault systémy, audit logy mimo Codex. Auto-review je ochrana proti omylu a unáhlenosti, ne proti odhodlanému útočníkovi nebo modelu, který se chová strategicky.

Souhrn

Auto-review je pragmatická odpověď na problém, který si kódovací agenti sami vyrobili — jakmile uživatelé začnou obcházet bezpečnostní brzdy z frustrace, je celá ochrana fikce. Číselně to OpenAI ukazuje v dobrém světle: méně tření, vysoká schvalovací míra, slušné metriky proti synteticky generovaným útokům. Ale i samotný OpenAI varuje, aby Auto-review nebyl chápaný jako determinismus. Je to LLM hlídající LLM, se vším, co k tomu patří — sdílenými chybami, omezenou robustností proti důmyslnému útoku, neschopností zachytit scheming uvnitř sandboxu.

Pro vývojáře, kteří chtějí pustit Codex na delší úkoly bez stálého dohledu, je to znatelný posun. Pro bezpečnostní týmy je to argumentační materiál pro debatu, kde je hranice akceptovatelného rizika. Pro Anthropic a další konkurenty je to signál, že OpenAI bere otázku autonomie agenta vážně a má v ruce konkrétní mechanismus, kterým ji posouvá. Dalších šest měsíců ukáže, jestli se v praxi objeví útoky, kterým Auto-review neodolá, a jak rychle OpenAI dokáže reagovat.